ICLR2022 spotlight

论文总的目的是以空间换时间和精度,而具体的空间开销以图的形式存储。

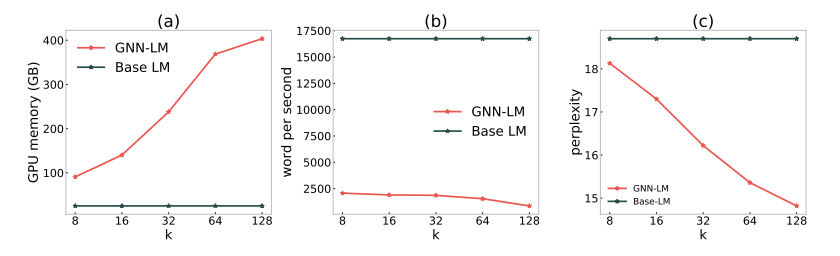

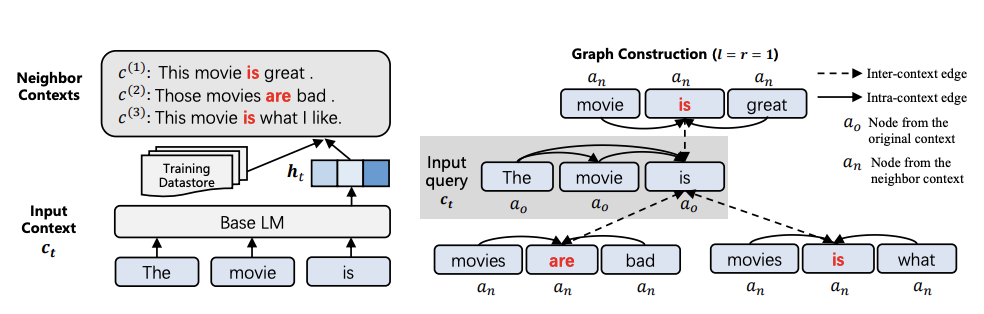

本文提出了GNN-LM,将图神经网络与语言模型相结合,通过在整个训练语料库中引用相似的上下文,扩展了传统的语言模型。使用k近邻检索与输入的表示最相似的邻居,模型为每个输入构建了一个有向异构图,其中节点是来自输入上下文或检索到的邻居上下文的token,边表示token之间的连接。然后利用图神经网络从检索到的上下文中聚合信息,以解码下一个token。实验结果表明,GNN-LM在标准数据集中优于强基线,并且通过与kNN-LM结合,能够在WikiText-103上取得最优效果。

从闭卷考试到开卷考试 对于传统的LM,我们会令神经网络学习数据中的知识,而在测试时这些数据是不可见的,这就类似“闭卷考试”。这时,影响模型测试的准确率的因素,或者说影响我们“考试成绩”的因素,就是是否能够准确的记住所有的数据/“知识点”。而作者提到,开卷考试一般比闭卷考试简单,因此令训练数据在测试时是可见的,我们在面对“考试题”的时候会去“书本”上查找最相关的知识点来解答。而这里知识点匹配的算法则是KNN-LM,得到的知识点构建图来回答问题。

如上图右侧所示,对于输入的context,首先借助KNN-LM生成近邻\(\mathcal{N}\left(\boldsymbol{c}_{t}\right)=\left\{\boldsymbol{c}_{t_{1}}^{(1)}, \ldots, \boldsymbol{c}_{t_{k}}^{(k)}\right\}\)。而后对检索出来的语句和测试语句构建一个异构图,包含\(a_0\)和\(a_n\)两类节点,分别对应查询语句中的token和近邻的token,接下来对构建的图应用GNN,得到输入语句的最后一个token的representation用以预测