Multi-hop Question Generation with Graph Convolutional Network

Code: link

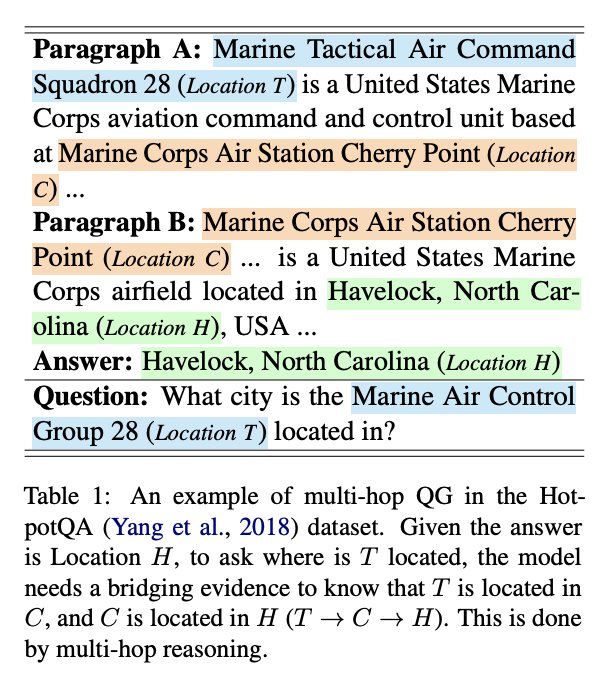

Background

问题生成(QG)是一个从给定的上下文自动生成问题或答案的任务,而多跳问题生成 (Multi-hop Question Generation) 需要从多个不同的段落中推理生成与答案相关的问题。QG可以应用于教育系统,也可以结合QA模型作为双重任务来增强QA系统的推理能力。对于多跳问题生成,核心问题在于如何连接多个段落间的零散的信息以及答案。

模型

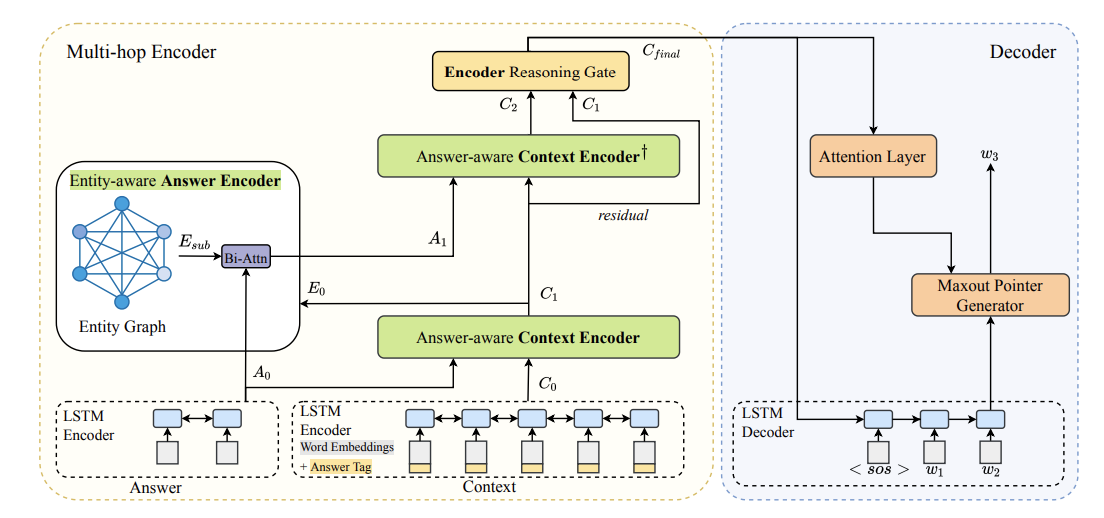

Multi-hop Encoder

对于输入的文本段落和答案,先分割成word-level的token,并分别用pre-trained Glove进行embedding,并在文本的token embedding中加入答案 embedding tag。对于得到的token embedding 输入到LSTM-RNN中学习初步的上下文相关的representation,再输入到Encoder中,模型的Encoder包括三个部分:

Answer-aware context encoder 这一部分参考了阅读理解中的co-attention reasoning机制: \[ \begin{aligned} S &=C_{0}^{T} A_{0} \in R^{n \times m} \\ S^{\prime} &=\operatorname{softmax}(S) \in R^{n \times m} \\ S^{\prime \prime} &=\operatorname{softmax}\left(S^{T}\right) \in R^{m \times n} \\ A_{0}^{\prime} &=C_{0} \cdot S^{\prime} \in R^{d \times m} \\ \tilde{C}_{1} &=\left[A_{0} ; A_{0}^{\prime}\right] \cdot S^{\prime \prime} \in R^{2 d \times n}\\ C_{1} &=\operatorname{BiLSTM}\left(\left[\tilde{C}_{1} ; C_{0}\right]\right) \in R^{d \times n} \end{aligned} \] 相关性矩阵S表示答案与上下文的相关性,整个过程比较复杂,这一模块的有效性在阅读理解任务中被验证,大致操作即将答案与文本计算attention后生成新的“答案”而后同样进行一遍相关性计算,最后输入Bi-LSTM中。

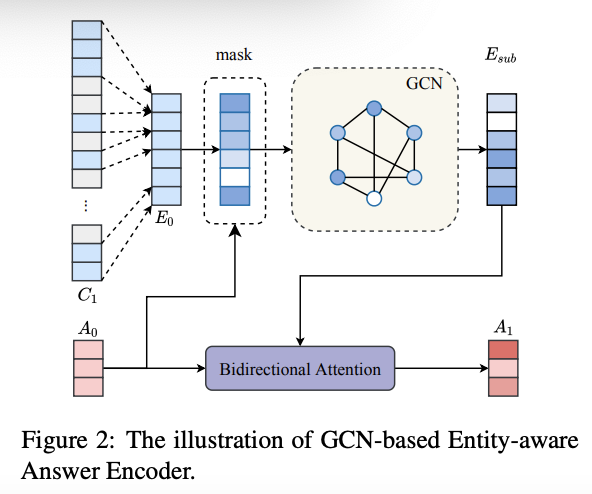

GCN-based entity-aware answer encoder 将上述encoder得到的embedding输入到GCN中进行多跳信息的嵌入。

图中的节点为文本中的命名实体(由BERT自动化提取),如果实体对在同一句子中,则为它们创建边。将上面Answer-aware context encoder 的结果结合到多跳图卷积中,并最终和图的结果结合,输入到Bi-attention模型,进一步得到token的representations \[

A_{1}=\text { BiAttention }\left(A_{0}, E_{M}\right)

\]

图中的节点为文本中的命名实体(由BERT自动化提取),如果实体对在同一句子中,则为它们创建边。将上面Answer-aware context encoder 的结果结合到多跳图卷积中,并最终和图的结果结合,输入到Bi-attention模型,进一步得到token的representations \[

A_{1}=\text { BiAttention }\left(A_{0}, E_{M}\right)

\]Gated encoder reasoning layer 将前面得到的结果输入到门控网络进行特征融合,进行特征保留或遗忘,得到最终的Encoder结果。

Maxout Pointer Decoder

模型采用单向LSTM作为解码器,而Maxout pointer这一模块也并不是由作者提出的,而是参考了他人的模型,用这一模块减少生成结果中的重复项。

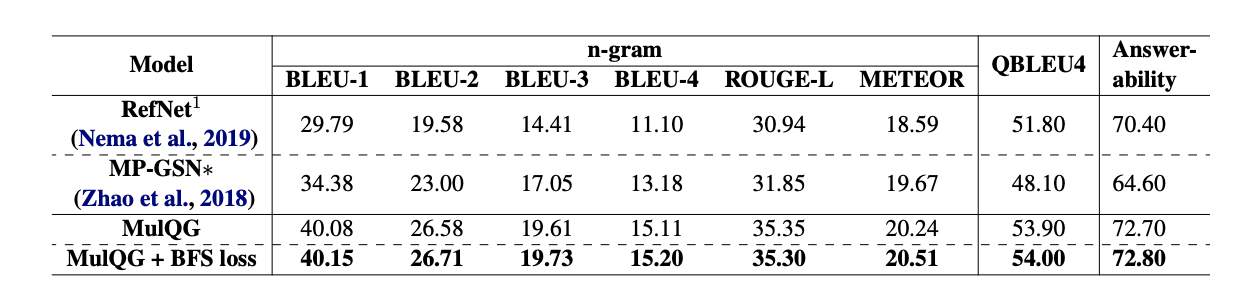

实验

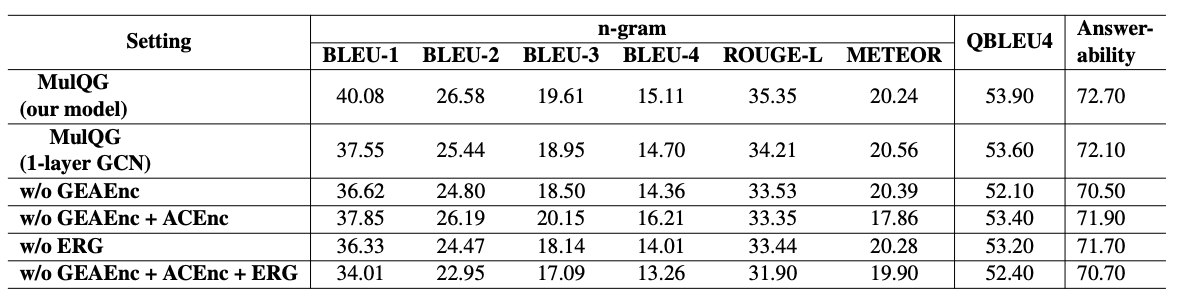

实验部分,作者分别做了与现有multi-hop QG模型对比以及消融实验,取得了SOTA结果,并且证明了框架中每个模块的意义。

总结

本文提出的框架总体来说比较复杂。往牛了说可以理解为整个框架模拟了人类的问题生成的过程,包括整体文本和答案的阅读,进行大概了解,而后对文本和答案中的实体进行关注,并寻找他们的联系,最后在生成问题时确定核心和次要信息,生成相关的问题。不过事实上整个框架就是对几个现有模型中的部分模块进行组装,类似“搭积木”的过程。而新加入的multi-hop图卷积部分整体方法也不具有很亮点的想法,从消融实验结果中也可以看出这一模块对最终结果的提升也并不是很明显。